这份教程将从核心原理、主流工具、工作流程、实战案例和未来展望五个方面,为你提供一份全面、系统、易于上手的AI效果图制作指南。

(图片来源网络,侵删)

第一部分:核心原理 - AI是如何“画”出图的?

在开始之前,理解AI的工作原理能让你更好地“驾驭”它,而不是盲目地“猜测”。

-

核心模型:扩散模型

- 简单理解: 想象一张全是“电视雪花”的纯噪点图,AI的工作就是,根据你输入的文字描述,一步步地把这张噪点图“去噪”,最终变成一张清晰的、符合描述的图片。

- 过程: 它会不断预测“下一步应该去掉哪些噪点才能更像我描述的场景”,经过成百上千步的迭代,最终生成图片。

-

关键概念:提示词

- 提示词就是你的指令。 你描述得越清晰、越具体,AI生成的图片就越符合你的预期。

- 构成要素:

- 主体:

a cozy living room,a futuristic kitchen,a minimalist bedroom - 风格:

photorealistic,3D render,cinematic,oil painting,anime style - 视角:

wide-angle shot,from above,eye-level view,dutch angle - 光照:

soft morning light,dramatic cinematic lighting,neon lights,warm ambient light - 细节:

wooden floor,marble countertop,velvet sofa,potted plant - 质量/参数:

8K,UHD,highly detailed,sharp focus,professional photography

- 主体:

第二部分:主流工具 - 选择你的“画笔”

制作效果图主要分为两大类工具:文生图 和 图生图。

(图片来源网络,侵删)

文生图 - 从零开始,用文字创造

这是最入门的方式,你只需要输入文字描述,AI就能生成一张全新的图片。

-

Midjourney:

- 特点: 目前效果最惊艳、最逼真、艺术感最强的工具之一。 尤其擅长营造氛围感和光影细节,生成的图片质感非常高,像专业摄影师的作品。

- 平台: 主要在社交软件

Discord上使用。 - 适合人群: 追求极致视觉效果、概念设计、氛围营造的设计师和艺术家。

-

Stable Diffusion (开源模型):

- 特点: 最灵活、可定制性最强的工具。 模型完全开源,你可以自己下载模型,在本地电脑或云服务器上运行,拥有庞大的社区和海量的定制模型(如Realistic Vision, Juggernaut等),可以生成各种特定风格。

- 平台: 需要搭配

Stable Diffusion WebUI(AUTOMATIC1111) 或ComfyUI等界面使用。 - 适合人群: 喜欢折腾、需要高度定制化、希望本地部署或有特定风格需求的专业用户。

-

DALL-E 3 (集成在 ChatGPT Plus / Microsoft Copilot / Bing Image Creator):

(图片来源网络,侵删)

(图片来源网络,侵删)- 特点: 理解能力最强的文生图模型。 你可以用非常口语化、复杂的句子来描述,它能准确理解你的意图,逻辑性非常好,生成的图片风格比较现代、干净。

- 平台: ChatGPT (Plus用户)、Microsoft Copilot (免费)、Bing Image Creator (免费)。

- 适合人群: 普通用户、设计师,特别是需要快速将复杂想法可视化的人。

图生图 - 在现有基础上精修

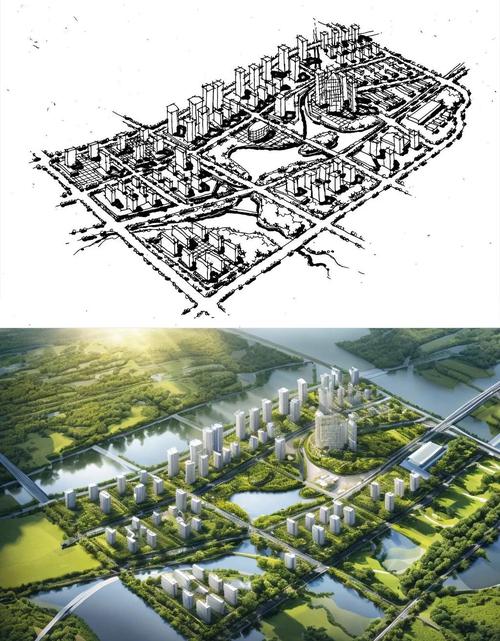

这是制作效果图的核心环节,它不是凭空创造,而是基于你提供的“线稿”、“参考图”或“草图”进行上色、细化、材质化和渲染。

-

ControlNet (与Stable Diffusion搭配使用):

- 特点: AI绘图领域的“革命性”插件。 它可以让你通过一张参考图,精确控制生成图片的姿势、构图、深度、线稿等,有了它,你就可以像传统3D软件一样,先搭好框架,再让AI填充细节。

- 常用控制类型:

Canny: 提取参考图的边缘,生成相同轮廓的图片。Depth: 控制画面的前后关系和空间感。OpenPose: 控制人物或物体的姿态。Scribble: 你随手画几笔,AI就能帮你把它变成具体的物体。IP-Adapter: 让AI模仿参考图的构图、风格甚至颜色。

-

Inpainting (局部重绘):

- 特点: 你可以遮住图片的某个区域,然后输入文字描述,让AI只重绘这个区域,而保持其他部分不变,非常适合用来修改细节、替换家具、添加装饰等。

第三部分:标准工作流程 - 一张效果图是如何诞生的?

结合上述工具,一个高效的AI效果图制作流程如下:

流程图:

明确需求 -> 生成线稿/草图 -> 构图与空间控制 -> 材质与光影渲染 -> 后期精修

详细步骤:

第1步:明确需求与构图

- 思考: 你想要什么样的空间?客厅?卧室?风格是现代、工业风还是北欧?主要功能是什么?

- 工具: 你可以自己手速一张简单的线稿,或者用简单的几何图形(如矩形代表墙体、家具)在纸上画一个平面布局草图,甚至可以用简单的3D软件(如SketchUp)快速拉一个体块模型。

- 目标: 得到一张能表达空间布局、基本形态和视角的“蓝图”。

第2步:使用ControlNet进行构图

- 工具:

Stable Diffusion + ControlNet。 - 操作:

- 将你上一步的线稿/草图上传到ControlNet的

Canny或Scribble预处理器中。 - 在提示词框里,详细描述你想要的场景:

a modern living room, minimalist style, large sofa, big window, view of city, cinematic lighting, photorealistic, 8k。 - 生成图片,AI会严格遵循你的线稿结构,但填充上你描述的材质、光影和细节。

- 关键: 这一步决定了你效果图的“骨架”,确保了空间逻辑的正确性。

- 将你上一步的线稿/草图上传到ControlNet的

第3步:材质与光影渲染

- 工具:

Stable Diffusion或Midjourney。 - 操作:

- 从上一步生成的、构图满意的结果中,选择一张最好的作为基础图。

- 使用

Inpainting (局部重绘)功能,或者直接在新的提示词迭代中,重点强调材质和光影。 - 提示词示例:

- 强调材质:

leather sofa,marble floor with reflections,brushed metal coffee table - 强调光影:

sunlight streaming through the window, creatinglong shadows,warm and cozy atmosphere,global illumination

- 强调材质:

- 多次生成,选择光影和材质最符合你想象的一张。

第4步:迭代优化与多图融合

- 工具:

Photoshop,Topaz Gigapixel AI(放大),LeiaPix(3D效果)。 - 操作:

- 迭代: 很少有一次就完美的,你可能需要回到第2步或第3步,调整提示词或参考图,重新生成,直到满意为止。

- 融合: 你可以把生成的几张图(一张光影好,一张材质好)在Photoshop里进行图层叠加,利用蒙版取长补短。

- 后期: 在Photoshop里进行最终的调色、增加光晕、添加配饰、锐化等操作,让画面更完美。

第5步:添加人物与生活气息(可选)

- 工具:

Stable Diffusion + ControlNet (OpenPose)。 - 操作:

- 找一张人物姿态图,用ControlNet的

OpenPose提取姿态。 - 将这个姿态信息应用到你的场景图中。

- 使用Inpainting功能,在人物位置输入提示词:

a young woman reading a book on the sofa,a family having dinner。 - 生成,让AI把人物“画”进你的空间里,并保持正确的透视和光影。

- 找一张人物姿态图,用ControlNet的

第四部分:实战案例 - 快速入门案例

案例:生成一张“现代简约风格客厅”的效果图

-

准备线稿: 在纸上画一个简单的矩形,里面画一个L型沙发、一个茶几、一扇大窗户,或者从网上找一个简单的客厅平面图。

-

使用Stable Diffusion + ControlNet:

- 打开

Stable Diffusion WebUI,上传你的线稿。 - 在

ControlNet标签页,选择Canny,上传线稿,并勾选Enable。 - 在提示词框输入:

modern minimalist living room, L-shaped sofa, glass coffee table, large floor-to-ceiling window with city view, white walls, wood flooring, natural light, photorealistic, 8k, sharp focus。 - 在负面提示词框输入:

blurry, ugly, deformed, extra limbs, watermark, text(避免低质量元素)。 - 点击生成,等待结果。

- 打开

-

迭代与优化:

- 假设生成的沙发材质不对,使用Inpainting,把沙发框选出来。

- 在Inpainting的提示词框里修改为:

velvet sofa in dark grey。 - 生成,这次AI会只修改沙发的材质。

-

最终处理:

- 将最满意的图片下载到本地。

- 用

Photoshop调整一下色温,让光线更温暖,或者锐化一下细节,让画面更清晰。 - 完成!

第五部分:进阶技巧与未来展望

进阶技巧:

- LoRA模型: Stable Diffusion的“插件”,可以让你学习特定风格、特定物体或特定人物的“特征”,你可以加载一个“宜家风格”的LoRA,让AI更擅长画宜家的家具。

- 提示词工程: 学习使用括号 来增强权重

(sofa:1.2),使用[ ]来减弱权重[ugly:0.5]。 - 多图融合: 使用

Deforum或AnimateDiff等工具制作简单的空间漫游动画。

未来展望:

- 3D生成: AI正在从2D图片生成,直接走向3D模型生成(如Luma AI, OpenAI的Shap-E),未来可能直接输入文字,就能生成一个可交互的3D空间。

- 实时渲染: AI驱动的实时渲染引擎将极大改变游戏和建筑可视化行业。

- 无缝工作流: AI将深度整合进现有的设计软件(如Blender, SketchUp, Rhino),成为设计师的智能助手,而非独立的工具。

AI制作效果图是一个“人机协作”的过程,AI是你的“超级实习生”,拥有无限的创意和执行力,但需要你来提供清晰的“创意总监”指令。

学习路径建议:

- 从Midjourney或DALL-E 3开始: 先熟悉提示词,感受AI的能力。

- 转向Stable Diffusion + ControlNet: 这是专业制作的核心,掌握它,你就拥有了从0到1构建任何空间的能力。

- 拥抱迭代: 不要指望一次成功,把每一次生成都看作一次探索,不断调整和优化。

祝你玩得开心,创造出惊艳的作品!