当然可以!免费下载网页源代码的方法有很多,从浏览器自带的功能到专业的开发者工具,再到专门的下载工具,可以根据你的需求选择最合适的一种。

(图片来源网络,侵删)

下面我将为你详细介绍几种最常用、最有效的方法,从简单到专业,并附上详细的步骤。

使用浏览器自带功能(最简单,适合查看和保存单个页面)

这是最基础的方法,几乎所有现代浏览器(如 Chrome, Firefox, Edge, Safari)都支持,它可以直接保存你当前浏览的网页,包括 HTML 文件和相关的图片、CSS、JS 等资源。

以 Google Chrome 浏览器为例:

-

打开目标网页:在浏览器中输入你想要下载源代码的网址,

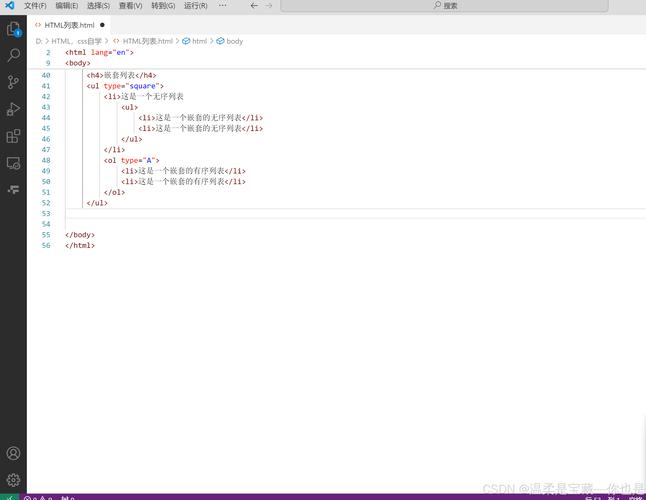

https://www.example.com。 (图片来源网络,侵删)

(图片来源网络,侵删) -

打开菜单:点击浏览器右上角的三个点(⋮)按钮。

-

选择“另存为”:在弹出的菜单中,将鼠标移动到“更多工具”,然后点击“将网页另存为...”。

-

选择保存格式:在弹出的“保存网页”对话框中,你会看到一个“保存类型”或“格式”的下拉菜单,这里有两个关键选项:

- 网页,仅 HTML:只保存网页的源代码(HTML 文件),不包含图片、样式表等外部资源,文件体积小,但打开后可能样式错乱,图片无法显示。

- 网页,完整:(推荐) 保存网页的源代码,同时会自动下载并保存网页中用到的所有图片、CSS 样式表、JavaScript 脚本等文件,浏览器会创建一个文件夹,将 HTML 文件和这些资源文件放在一起,这样,你可以在离线状态下完整地打开这个网页。

-

选择保存位置并点击保存:选择一个你想要保存的位置,然后点击“保存”。

(图片来源网络,侵删)

(图片来源网络,侵删)

优点:

- 无需安装任何额外软件。

- 操作简单直观。

缺点:

- 只能保存你当前正在浏览的页面,无法批量下载。

- 对于由 JavaScript 动态生成内容的“单页应用”(SPA),保存的 HTML 可能不包含最终渲染的内容。

使用浏览器开发者工具(最专业,适合查看和分析代码)

如果你不仅想下载,还想学习、分析或修改网页的源代码,那么开发者工具是你的不二之选,它无法直接“下载”整个项目,但可以让你完美地复制你想要的任何部分。

以 Google Chrome 浏览器为例:

- 打开目标网页。

- 打开开发者工具:按下键盘快捷键

F12,或者右键点击页面任意位置,选择“检查”。 - 查看和复制代码:

- 查看 Elements (元素) 面板:这是最常用的面板,它会显示当前网页的 HTML 结构,并且是实时渲染的,你可以看到最终呈现的 HTML 是什么样子的。

- 定位代码:在 Elements 面板中,你可以直接点击你感兴趣的元素,代码会高亮显示,左侧也会实时显示对应的页面部分。

- 复制代码:

- 复制单个元素:右键点击你想要复制的 HTML 标签,选择“复制” -> “复制元素”。

- 复制父级元素:如果需要包含其所有子元素,选择“复制” -> “复制外部 HTML”。

- 复制整个页面:在 Elements 面板中,右键点击最顶层的

<html>标签,选择“复制” -> “复制外部 HTML”,即可复制完整的 HTML 结构。

优点:

- 可以看到浏览器最终渲染的、包含动态内容的 HTML。

- 可以实时调试 CSS 和 JavaScript,是学习和修改代码的利器。

缺点:

- 需要手动复制,无法一键下载整个网站。

- 对于大型网站,手动复制所有文件非常耗时。

使用专门的网站下载工具(最强大,适合完整克隆整个网站)

如果你想下载一个完整的网站,包括所有页面、图片、样式和脚本,并让它们可以在本地通过浏览器正常浏览(即建立一个本地镜像),那么你需要使用专门的“网站爬虫”或“离线浏览器”工具。

这类工具会自动抓取网站的所有链接,并按照网站的目录结构下载所有文件。

推荐工具:

-

HTTrack Website Copier:

- 特点:完全免费、开源、功能强大,是这类工具中最经典的代表。

- 工作原理:你给它一个网址,它会设置“机器人”来扫描网站,然后将所有下载的文件存放在你指定的本地目录中,并自动修正链接,确保本地浏览时一切正常。

- 官网:https://www.httrack.com/

-

Wget:

- 特点:一个强大的命令行工具,在 Linux 和 macOS 系统中自带,Windows 也可以安装,功能极其强大和灵活,适合高级用户。

- 基本用法示例:打开命令行(CMD 或 PowerShell),输入以下命令即可下载整个网站。

wget --mirror --convert-links --adjust-extension --page-requisites --no-parent http://example.com

- 参数说明:

--mirror:镜像模式,相当于-r -N -l inf --no-remove-listing。--convert-links:下载后,将链接转换为适合本地浏览的格式。--page-requisites:下载所有显示网页所需的文件,如图片、CSS 等。

优点:

- 可以一键下载整个网站,自动处理链接和资源。

- 能建立完整的本地离线副本。

缺点:

- 下载大型网站会占用大量磁盘空间和时间。

- 可能会受到网站

robots.txt文件和服务器速率限制的约束。 - 使用不当可能会对目标服务器造成较大负担。

总结与选择建议

| 方法 | 优点 | 缺点 | 适用场景 |

|---|---|---|---|

| 浏览器另存为 | 简单、无需工具、可保存完整资源 | 无法批量下载、对动态内容支持差 | 临时保存单个、简单的网页 |

| 开发者工具 | 专业、可查看最终渲染代码、可调试 | 需手动复制、无法下载整个项目 | 学习、分析、修改网页源代码 |

| 网站下载工具 | 功能强大、可完整克隆整个网站 | 占用空间大、使用复杂、有服务器负担 | 需要建立完整的本地网站镜像、批量下载 |

给你的建议:

- 如果你只是想保存一个自己喜欢的网页:使用方法一(浏览器另存为),并选择“网页,完整”格式。

- 如果你想学习某个网页是怎么做的:使用方法二(开发者工具),在 Elements 面板中分析和复制代码。

- 如果你想下载一个完整的网站,比如一个教程网站,方便离线阅读:使用方法三(HTTrack 或 Wget)。

希望这些信息能帮到你!